Şirketinde Yapay Zeka Kararlarını Kim Veriyor?

IT mi, Strateji mi, Yoksa Kimse mi?

Bir test yapalım.

Şirketinizde birisi Microsoft Copilot’a müşteri verisini yapıştırıp analiz ettirdi. Başka birisi ChatGPT ile sözleşme taslağı oluşturdu. Bir diğer ekip, Copilot üzerinden Excel’de otomatik raporlama kurmaya çalışıyor.

Soru: Bu üç senaryodan hangisi için yazılı bir kuralı var şirketinizin?

Çoğu şirket için cevap: Hiçbiri. Ve bu tahmin değil, veri.

Rakamlar Ne Diyor?

EY’nin Şubat 2026’da 500 ABD teknoloji yöneticisiyle yaptığı araştırma, durumu çok net ortaya koyuyor:

Yapay zeka girişimlerinin %52’si resmi onay veya denetim olmadan çalışıyor. Yani şirketlerin yarısından fazlasında departmanlar kendi başlarına yapay zeka projeleri yürütüyor, kimse kontrol etmiyor.

Liderlerin %78’i yapay zeka benimsenmesinin, riskleri yönetme kapasitelerini aştığını söylüyor. Hız var, yönetişim yok.

%45’i yetkisiz yapay zeka araç kullanımından kaynaklanan veri sızıntısı yaşamış. %39’u fikri mülkiyet sızıntısı tespit etmiş. Bunlar şüphe değil, doğrulanmış vakalar.

Gartner’ın Şubat 2026 raporu tabloyu daha da netleştiriyor:

Kurumların %98’i onaysız yapay zeka kullanımı raporluyor. Neredeyse hiçbir şirket gölge yapay zekadan muaf değil. %49’u önümüzdeki 12 ay içinde gölge yapay zeka kaynaklı bir olay bekliyor.

Yapay zeka yönetişim pazarı 2026’da 492 milyon dolara ulaştı. 2030’da 1 milyar doları aşması bekleniyor. Regülasyon baskısı artıyor, dünya ekonomilerinin %75’inde yapay zeka düzenlemesi olacak.

Bir yıl öncesine bakalım: 2025’te şirketlerin %78’i en az bir iş fonksiyonunda yapay zeka kullanıyordu (McKinsey). Ama resmi yapay zeka politikası olanlar %14’te kalıyordu. 2026’da kullanım daha da yaygınlaştı, ama politika açığı hâlâ devasa.

Copilot Her Yerde, Ama Tek Araç Değil

Fortune 500 şirketlerinin %70’i Microsoft 365 Copilot’u benimsemiş durumda. Ama çalışanlara hem Copilot hem ChatGPT erişimi verildiğinde, %76’sı ChatGPT’yi tercih ediyor, yalnızca %18’i Copilot’u seçiyor. IT’nin onayladığı araç ile çalışanların fiilen kullandığı araç farklı.

Gölge Yapay Zekanın Gerçek Maliyeti

Çalışanların %71,6’sı kurumsal olmayan hesaplarla yapay zeka araçlarına erişiyor. IBM’in 2025 verilerine göre gölge yapay zeka ihlalleri, standart veri ihlali maliyetine (3,96 milyon dolar) ek olarak 670 bin dolar daha çıkarıyor, toplam maliyet 4,63 milyon dolara ulaşıyor.

Çalışanların %77’si ChatGPT ve benzeri araçlarla hassas şirket verisi paylaşıyor. Şirketlerin yalnızca %17’sinde bunu engelleyecek teknik kontrol var.

Gartner’a göre gölge yapay zeka artık sadece chatbot kullanımıyla sınırlı değil. Otonom yapay zeka ajanları, çalışanlar tarafından veya SaaS araçlarına gömülü şekilde, insan denetimi olmadan karar veriyor, veriye erişiyor, sistemlerle etkileşime giriyor. Bu yeni nesil gölge yapay zeka, öncekinden çok daha zor tespit ediliyor.

Politikasız Yapay Zeka Kullanımı Neden Tehlikeli?

Yapay zeka araçları artık sadece IT departmanının kullandığı teknik araçlar değil. Microsoft 365 Copilot, Teams toplantılarını özetliyor, Word’de taslak yazıyor, Excel’de formül üretiyor. ChatGPT ayrı bir pencerede açık. Satıştan insan kaynaklarına, finanstan hukuka her departmanda en az bir yapay zeka aracı var. Ama çoğu şirkette şu üç şey eksik:

Kim karar veriyor? Yapay zeka araç seçimini kim yapıyor? Copilot lisansını IT mi aldı, yoksa birisi kendi kredi kartıyla mı ChatGPT Plus’a abone oldu? Sınır nerede?

Neye göre karar veriliyor? Bir kriter seti var mı, yoksa “kullanışlı görünüyor” yeterli mi?

Bir şey ters giderse ne oluyor? Copilot yanlış bir özet çıkardığında, ChatGPT hatalı bir sözleşme maddesi önerdiğinde, bir veri sızıntısı olduğunda sorumluluk kimin?

Bu üç soruya net cevap veremeyen her şirket, gizli bir risk taşıyor.

Yapay Zeka Etik Politikası Nedir, Ne Değildir?

Yapay zeka etik politikası, 50 sayfalık hukuk jargonuyla dolu bir doküman değil. Çalışanların “bunu yapabilir miyim?” sorusuna net cevap veren bir rehber.

İyi bir yapay zeka etik politikası şu işi yapar: belirsizliği azaltır. Çalışanlar neyi yapabileceklerini, neyi yapmadan önce sormaları gerektiğini, neyi asla yapmamaları gerektiğini bilir.

Kötü bir yapay zeka etik politikası ise ya çok geneldir (kimse uygulamaz) ya da çok katıdır (kimse uymaz).

Eğitim verdiğim bazı şirketlerde yazılı bir politika var ama çalışanlar haberdar değil!

Gartner’ın 360 kurum üzerinde yaptığı araştırma bunu doğruluyor: Yapay zeka yönetişim platformu kullanan şirketler, kullanmayanlara kıyasla 3,4 kat daha etkili yönetişim sağlıyor. Fark, politikanın varlığından değil, uygulanabilir bir sisteme dönüştürülmesinden geliyor.

Bir Yapay Zeka Etik Politikasında Olması Gereken 7 Alan

Aşağıdaki şablon, sektörden bağımsız olarak her şirketin kendi politikasını oluştururken başlangıç noktası olarak kullanabileceği bir çerçeve. Olduğu gibi kopyalamak için değil, kendi şirketinize uyarlamak için kullanın.

ŞABLON: [Şirket Adı] Yapay Zeka Kullanım ve Etik Politikası

Versiyon: 1.0 Geçerlilik Tarihi: [Tarih] Sorumlu Birim: [Birim adı] Sonraki Gözden Geçirme: [6 ay sonrası]

1. AMAÇ VE KAPSAM

Bu politika, [Şirket Adı] bünyesinde yapay zeka araçlarının kullanımı, değerlendirilmesi ve yönetimi için temel kuralları belirler. Tüm çalışanlar, yükleniciler ve iş ortakları için geçerlidir.

Kapsam: Microsoft 365 Copilot, ChatGPT, Claude, Gemini gibi üretken yapay zeka araçları, yapay zeka destekli iş uygulamaları (Power Automate, Power BI Copilot vb.), otomasyon çözümleri, yapay zeka tabanlı karar destek sistemleri.

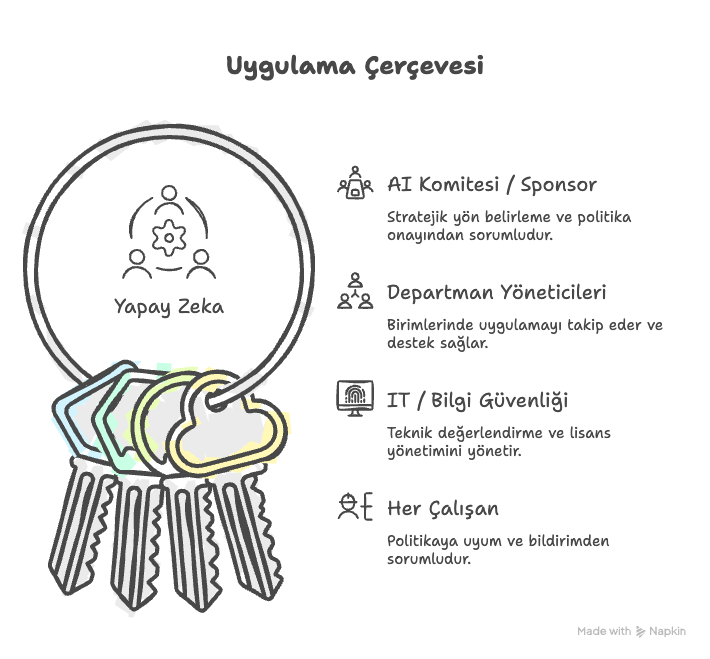

2. SORUMLULUK VE YÖNETİŞİM

Not: Yapay Zeka Komitesi yoksa, en azından bir “Yapay Zeka Sorumlusu” atanmalıdır. Bu kişinin hem teknik bilgisi hem iş süreci anlayışı olmalı. Wharton’ın 2025 araştırmasına göre, üst yönetimin yapay zeka yönetişimine aktif katıldığı şirketler, bu işi sadece teknik ekiplere bırakanlara kıyasla belirgin şekilde daha fazla iş değeri üretiyor.

3. ONAYLANMIŞ VE YASAKLANMIŞ KULLANIMLAR

Onaylı kullanımlar (ek onay gerekmez):

Microsoft 365 Copilot ile iç doküman taslağı oluşturma (son onay insanda)

Copilot veya ChatGPT ile kamuya açık bilgilerden araştırma ve özet çıkarma

Excel Copilot ile formül ve grafik desteği alma (şirket dışı veri içermeden)

Eğitim ve öğrenme amaçlı kullanım

Koşullu kullanımlar (yönetici onayı gerekir):

Müşteri iletişiminde yapay zeka destekli içerik kullanımı

ChatGPT veya diğer üçüncü parti yapay zeka araçlarına şirket içi dokümanların yüklenmesi

Yeni bir yapay zeka aracının iş sürecine entegrasyonu

Yapay zeka çıktısının dış paydaşlara sunulması

Teams Copilot ile müşteri toplantılarının özetlenmesi

Yasaklanmış kullanımlar:

Kişisel verilerin (KVKK/GDPR kapsamındaki) onaysız olarak herhangi bir yapay zeka aracına yüklenmesi

Yapay zeka çıktısının insan incelemesi olmadan nihai karar olarak kullanılması

Gizli veya ticari sır niteliğindeki bilgilerin üçüncü parti yapay zeka araçlarına (ChatGPT, Gemini vb.) girilmesi

Yapay zeka ile sahte, yanıltıcı veya manipülatif içerik üretimi

4. VERİ GÜVENLİĞİ VE GİZLİLİK

Hiçbir çalışan, şirketin gizlilik sınıflandırmasında “gizli” veya “iç kullanım” olarak işaretlenmiş veriyi onaysız olarak dış yapay zeka aracına yükleyemez.

Microsoft 365 Copilot, şirketin Microsoft tenant’ı içinde çalışır. Veri şirket sınırları içinde kalır. Ancak üçüncü parti araçlar (ChatGPT, Gemini, Claude) için ayrı veri güvenliği değerlendirmesi yapılmalıdır.

Yapay zeka araçları seçilirken veri işleme politikaları, veri depolama lokasyonu ve üçüncü taraflarla paylaşım koşulları değerlendirilmelidir.

Yapay zeka aracına girilen verilerin “model eğitimi için kullanılıp kullanılmadığı” kontrol edilmelidir. (Not: Copilot, kurumsal verileri model eğitimi için kullanmaz. ChatGPT’nin kurumsal planı da kullanmaz, ama ücretsiz veya Plus planları farklı çalışır.)

Şirketlerin %86’sının yapay zeka veri akışlarına dair görünürlüğü yok (Cyberhaven, 2025). Veri sınıflandırma ve izleme sistemi kurmak, politikanın uygulanabilirliği için kritik.

5. ŞEFFAFLIK VE BEYAN

Yapay zeka destekli üretilen içeriklerin dış paylaşımında, yapay zeka kullanımı beyan edilmelidir. (Örnek: “Bu rapor yapay zeka destekli olarak hazırlanmıştır.”)

Müşteriye yönelik yapay zeka tabanlı karar sistemlerinde, kararın yapay zeka tarafından desteklendiğini açıklamak zorunludur.

Yapay zeka çıktıları, insan tarafından doğrulanmadan nihai olarak kabul edilmemelidir.

6. YANLILIK (BIAS) VE ADALET

Yapay zeka destekli işe alım, performans değerlendirme veya müşteri segmentasyonu gibi kararlarda bias riski değerlendirilmelidir.

Herhangi bir yapay zeka aracı, korunması gereken gruplara karşı ayrımcılık yapıp yapmadığına yönelik periyodik olarak test edilmelidir.

Bias tespit edildiğinde, aracın kullanımı durdurulur ve düzeltme süreci başlatılır.

7. EĞİTİM VE FARKINDALIK

Her çalışan, işe başlama sürecinde yapay zeka kullanım politikası hakkında bilgilendirilir.

Yılda en az bir kez yapay zeka okuryazarlığı eğitimi düzenlenir.

Politika güncellemelerinde tüm çalışanlara bildirim yapılır.

Departmana özel yapay zeka kullanım senaryoları için ek eğitimler planlanır (örneğin: finans ekibine Excel Copilot, pazarlama ekibine ChatGPT içerik üretimi).

İHLAL VE YAPTIRIMLAR

Politika ihlallerinde:

İlk ihlal: Uyarı ve ek eğitim

Tekrar eden ihlal: Disiplin süreci

Kasıtlı veya ağır ihlal (veri sızıntısı vb.): Hukuki süreç

POLİTİKA GÜNCELLEME TAKVİMİ

Bu politika, 6 ayda bir veya önemli bir teknolojik/yasal değişiklik olduğunda gözden geçirilir. Güncelleme sorumluluğu Yapay Zeka Komitesi’ne aittir.

Bu Şablonu Kullanırken Dikkat Edilmesi Gerekenler

Kopyala-yapıştır yapmayın. Her şirketin risk profili, sektörü, büyüklüğü ve yapay zeka kullanım seviyesi farklı. Bu şablon bir başlangıç noktası, bitmiş bir ürün değil.

Kurumsal lisanslı yapay zeka araçları ile üçüncü parti araçları ayırın. Kurumsal lisanslı olduğunuz yapay zeka araçlarının politikalarını okuyun. Hatırlayın: çalışanların %76’sı bireysel yapay zeka lisanslarını da kullanıyor özellikle ChatGPT’yi tercih ediyor. Bu tercihi yasaklamak değil, güvenli kanallar içinde yönetmek gerekiyor.

Otonom yapay zeka ajanlarını unutmayın. 2026’nın yeni riski bu. SaaS araçlarına gömülü yapay zeka ajanları, insan denetimi olmadan karar veriyor ve veriye erişiyor. Gartner, kurumsal uygulamaların %40’ının 2026 sonuna kadar göreve özel yapay zeka ajanları içereceğini öngörüyor (2025’te bu oran %5’in altındaydı).

Hukuk ekibinizi dahil edin. Özellikle KVKK, GDPR ve sektörel regülasyonlara uyum için hukuk incelemesi şart. 2030’a kadar dünya ekonomilerinin %75’inde yapay zeka regülasyonu olacak (Gartner). Şimdiden hazırlanan şirketler avantajlı konumda olacak.

Çalışanlardan geribildirim alın. Politikayı sadece yukarı-aşağı dayatmayın. Gerçekte yapay zeka kullanan kişilerden girdi alın, yoksa politika kağıt üzerinde kalır.

Küçük başlayın, büyütün. 50 sayfalık bir doküman yerine, 2 sayfalık net bir rehberle başlayın. Zamanla genişletin.

Şimdi Sana Soracaklarım

Bu makaleyi okuduktan sonra şu soruları düşün ve yorumlarda paylaş:

Şirketinde yapay zeka kararlarını kim veriyor? IT mi, strateji mi, yoksa kimse mi?

Şirketinin yazılı bir yapay zeka kullanım politikası var mı? Varsa ne kadar güncel?

Çalışanlar kurumsal lisanslı yapay zeka uygulamaları dışında hangi yapay zeka araçlarını kullanıyor, bunu bilen var mı?

Yapay zeka çıktısı bir hata yapsa, sorumluluk kime ait?

Bu sorulardan birinin bile net cevabı yoksa, bir politikaya ihtiyacın var demektir.

Aksiyon Kontrol Listesi

Şirketindeki mevcut yapay zeka kullanım durumunu haritala (kim, ne kullanıyor? Copilot mu, ChatGPT mi, Claude mu, başka ne var?)

Yapay Zeka Sorumlusu veya Yapay Zeka Komitesi ata

Yukarıdaki şablonu şirketine uyarla, hukuk ekibine incelet

Kurumsal yapay zeka lisansı ile üçüncü parti araçlar için ayrı veri güvenliği kuralları belirle

Çalışan eğitim planını oluştur (erişim vermek yetmez, yetkinlik geliştir.)

6 aylık gözden geçirme takvimini belirle

İlk 30 gün içinde en az bir departmanda pilot uygula

Şirketinize özel yapay zeka politikası oluşturma konusunda destek almak isterseniz, benimle iletişime her zaman geçebilirsiniz.

Kaynaklar:

EY Autonomous AI Survey, Şubat 2026 (500 ABD teknoloji yöneticisi)

Gartner, “Global AI Regulations Fuel Billion-Dollar Market for AI Governance Platforms”, Şubat 2026

Gartner, “Top Predictions for Data and Analytics”, Mart 2026

Gartner, “Strategic Predictions for 2026”

Deloitte, “State of AI in the Enterprise”, 2026 (3.235 lider, 24 ülke)

McKinsey Global AI Survey, 2025

IBM Cost of a Data Breach Report, 2025

Wharton-GBK AI Adoption Report, 2025

Cyberhaven AI Adoption & Data Security Report, 2025

Bu bültende her gün yapay zeka ile çalışmanın gerçeklerini yazıyorum. Parlak vaatleri değil, gerçek deneyimleri. Abone ol, her yeni yazı sana gelsin.